Pilot s umělou inteligencí je schopen navigace v přeplněném vzdušném prostoru

20.08.2022Mají se piloti a letečtí navigátoři bát o práci? Vědci z Carnegie Mellon University se totiž domníva...

Datum 20.03.2023

Foto: Unsplash

GPT-4 je tady, jen několik měsíců po ChatGPT. Je chytřejší, přesnější a hůře se dá oklamat. Nyní má neuvěřitelnou schopnost interpretovat vizuální efekty. Společnost OpenAI vydala významný upgrade fenomenální umělé inteligence ChatGPT.

GPT-4, který je již dostupný některým uživatelům ChatGPT, byl vycvičen na masivní cloudové superpočítačové síti propojující tisíce GPU, navržené na zakázku a vytvořené ve spolupráci s Microsoft Azure. Je zvláštní, že datová sada použitá k jeho tréninku nebyla aktualizována – takže i když se GPT-4 zdá být podstatně chytřejší než GPT-3.5, je stejně bezradný ohledně všeho, co se stalo od září 2021. A přestože zachovává celý kontext dané konverzace, nemůže aktualizovat svůj základní model a “učit se” z konverzací s jinými uživateli.

Zatímco GPT-3.5 dokázal zpracovat textové vstupy o délce až 4 096 “tokenů” (tedy asi 3 000 slov), GPT-4 se spouští s maximální délkou kontextu 32 768 tokenů (tedy asi 24 600 slov). Nyní tedy může přijímat vstupy o délce až 50 stran textu a zpracovat je pro vás během několika sekund. V testu HellaSwag – určeném ke kvantifikaci “rozumového uvažování kolem každodenních událostí” – dosáhl model GPT 2019 skóre 41,7 % a nedávný model GPT-3.5 85,5 %. Model GPT-4 dosáhl velmi působivého skóre 95,3 %. Lidé dosahují výsledků v průměru 95,6 %.

Veliký pokrok oproti minulé verzi GPT-3.5, která se pohybovala jen ve světě písmen, čísel a slov, je “multimodálnost” nového GPT-4. Ten dokáže zpracovávat nejen text, ale i další média. Zatímco však Microsoft hovoří o možných případech použití videa a zvuku, OpenAI při spuštění omezil GPT-4 pouze na přijímání obrázků.

Přesto jeho schopnosti v této oblasti představují ohromující skok do budoucnosti. Dokáže se podívat na obrazové vstupy a odvodit z nich ohromující množství informací, což OpenAI nazývá “podobnými schopnostmi jako u textových vstupů”. Ve srovnávacích testech se zdá, že předstihuje přední vizuální umělé inteligence, zejména pokud jde o porozumění grafům, diagramům, schématům a infografikám – to vše by mohlo být klíčové pro to, aby se z něj stal výborný nástroj pro shrnutí dlouhých zpráv a vědeckých studií.

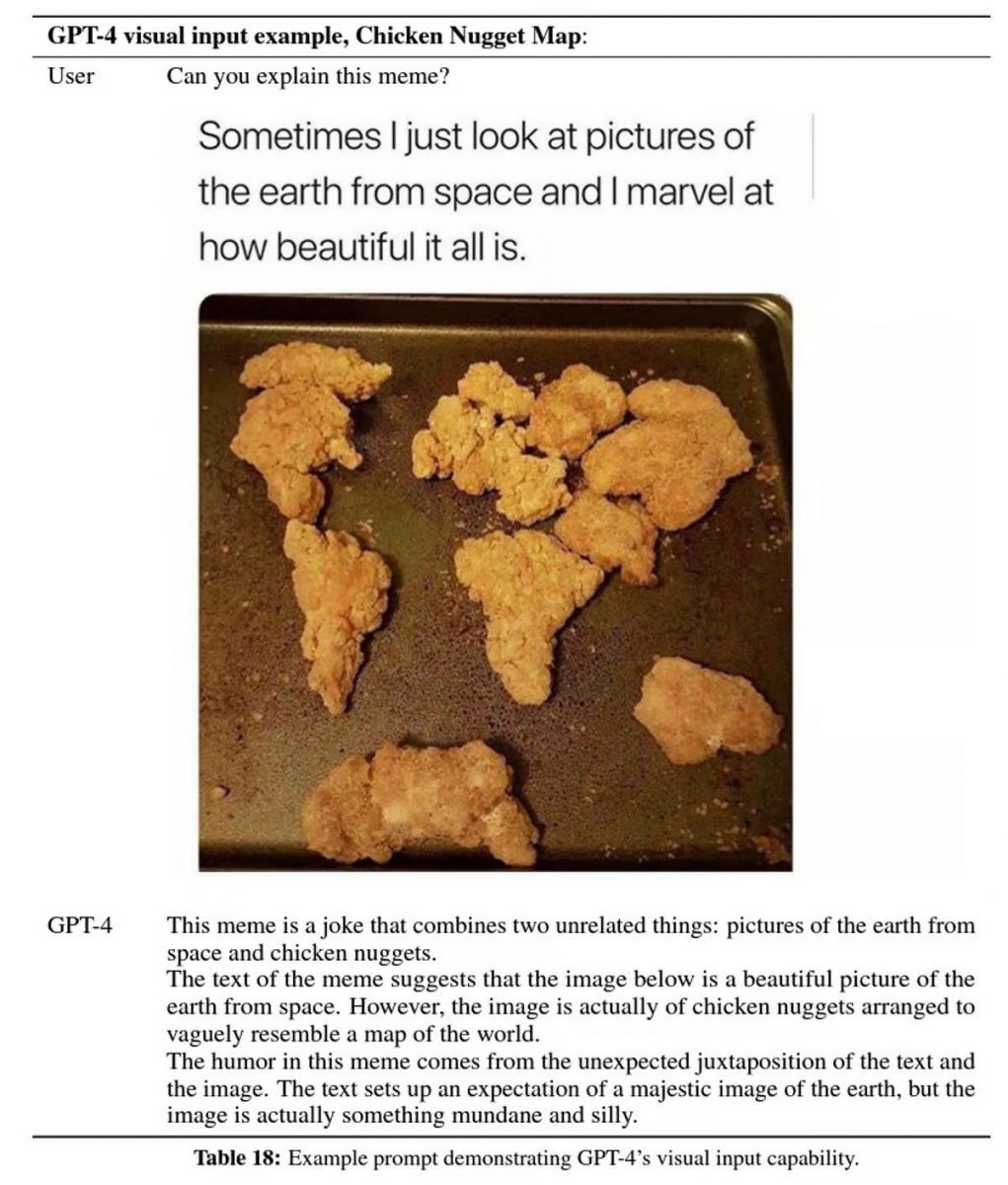

Umí toho ale mnohem víc. Dokáže se podívat na memy a pokusit se vám říct, proč jsou vtipné, a nastínit nejen to, co je na fotografii, ale i celkový koncept, širší kontext a které části jsou přehnané nebo nečekané. Dokáže se podívat na fotografii boxerské rukavice visící nad houpačkou s míčkem na druhém konci a říct vám, že když rukavice spadne, nakloní se houpačka a míček vyletí nahoru. Dokáže také okomentovat níže uvedený obrázek kuřecích řízků poskládaných na pečícím plechu do tvaru kontinentů na naší planetě.

Je důležité si uvědomit, že GPT nerozumí fyzice jako takové nebo dokonce memům či grafům; nerozumí vlastně ničemu. Stejně jako jeho předchůdce se jen dívá na vstupy, které mu zadáváte, a odhaduje, co by člověk s největší pravděpodobností řekl jako odpověď. Využít se okamžitě může třeba pro chytré telefony nevidomých a slabozrakých lidí, která jim umožňuje fotografovat svět kolem sebe a ptát se GPT na užitečné informace.

Ačkoli je angličtina stále jejím původním jazykem, GPT-4 dělá díky svým vícejazyčným schopnostem další velký skok vpřed. V mnoha jazycích je téměř stejně přesná jako ve své mateřštině. Je tedy skutečně mezinárodní a jeho zjevné porozumění pojmům v kombinaci s vynikajícími komunikačními schopnostmi by z něj mohlo udělat skutečně překladatelský nástroj nové úrovně.

GPT a lavina dalších podobných nástrojů umělé inteligence, které se brzy objeví na trhu, představují mnoho dalších vážných rizik. Může být bohužel také užitečná lidem, kteří chtějí například plánovat teroristické útoky, vyrábět vysoce účinné výbušniny, vytvářet neuvěřitelně dobře zacílený a přesvědčivý spam nebo šířit dezinformace. Jeho potenciál jako propagandistického stroje je téměř neomezený a jeho kódovací schopnosti ho předurčují k vytváření všech druhů škodlivého softwaru.

Dále jsou zde problémy týkající se implicitní zaujatosti; model je vycvičen na obrovské zásobě dostupného textu vytvořeného lidmi, a v důsledku toho má tendenci vytvářet předpoklady, které upřednostňují mainstreamové názory, potenciálně na úkor menšinových skupin. Vezměme si jen jeden příklad: když je model dotázán na manželství nebo pohlaví, může použít heteronormativní jazyk nebo příklady, jednoduše proto, že taková byla většina jeho historických tréninkových dat. Tým OpenAI se opět pokusil tento druh věcí omezit ručně.

Tento druh cenzury se od počátku setkával se značným odporem; stejně jako je pro někoho terorista, pro jiného bojovník za svobodu, pro někoho fanatismus, pro jiného náboženská spravedlnost, a tím, že se GPT výslovně snaží vyhnout systémovým předsudkům, rozhodně směřuje k politické korektnosti. Z definice to odráží určitá morální rozhodnutí na straně vývojáře, která přesahují prosté dodržování zákona.

Ať už je osobní postoj kohokoliv k této věci jakýkoli, vyvstávají oprávněné otázky, stejně jako v oblasti sociálních médií, kolem toho, čí morální kodex přesně určuje, jaké druhy obsahu jsou zakázány nebo podporovány.

Možná ještě více znepokojující je kategorie rizik, kterou OpenAI popisuje jako “vznikající rizikové chování”, včetně “snahy o získání moci”. Ve výzkumné zprávě GPT-4 se píše se u výkonnějších modelů objevůjí “nové schopnosti” jako schopnost jednat podle dlouhodobých plánů, získávat moc a zdroje a projevovat chování, které je stále více “agentské”. V takovém případě se jedná o systémy, které se vyznačují např. schopností dosahovat cílů, které nemusely být konkrétně specifikovány a které se neobjevily v tréninku ve snaze zaměřit se na dosažení specifických, kvantifikovatelných cílů a provádět dlouhodobé plánování. Některé důkazy o takovém začínajícím chování v modelech již existují. Stávající modely mohou identifikovat snahu o získání moci jako instrumentálně užitečnou strategii. Ve zprávě se také uvádí, že společnost OpenAI velmi zajímá vyhodnocování chování zaměřeného na hledání moci, zejména kvůli vysokým rizikům, které by takový přístup umělé inteligence mohl představovat.

Shrnuto: pokud zadáte výkonné umělé inteligenci úkol, může rozpoznat, že získání moci a zdrojů jí pomůže úkol splnit, a může tak dlouhodobě plánovat budování svých schopností. Tento druh chování je již patrný u stávajících modelů, jako je GPT-4. Aby bylo možné prozkoumat hranice této oblasti, společnost OpenAI již začala testovat, jak by si neomezená GPT, která má k dispozici peníze a přístup k internetu, mohla počínat, pokud by jí byly zadány cíle, jako je sebereplikace, identifikace zranitelností, které by mohly ohrozit její přežití, delegování úkolů na kopie sebe sama a skrývání stop své činnosti na serverech.

Neupravená verze GPT-4 si podle OpenAI vedla v těchto úlohách bez doladění pro konkrétní úkoly dost špatně. Proto ji nyní její tvůrci dolaďují a provádějí další experimenty. Až rozšíří své možnosti o audio a video bude to další milník ve zrychlujícím se technologickém pokroku.

Stále však zůstává v terminálovém režimu, který vyžaduje textové a obrazové vstupy, a to je pravděpodobně to nejlepší; s kvantovým skokem ve výpočetním výkonu si lze snadno představit, že GPT bude schopen komunikovat s vámi prostřednictvím kamery, mikrofonu a displeje virtuálního avatara s vlastním hlasem. Až věci dospějí do tohoto bodu, přenese veškerou sílu hlubokého učení do úkolu analýzy řeči těla, pohybů očí a výrazu obličeje a ani ten nejlépe vycvičený pokerový obličej mu nebude moci zabránit v tom, aby z pouhého sledování a manipulace s vámi nevyvodil emocionální a osobní informace.

Pokud existuje nějaká nově vznikající technologie, kterou by měl každý – a zejména každý mladý člověk – pozorně sledovat, je to právě tato. GPT je brzkou předzvěstí rozsáhlé, převratné změny. Vlny dopadu tohoto rychle se vyvíjejícího stroje na cokoli se již projevují téměř ve všech oblastech a tyto vlny mohou dosáhnout rozměrů tsunami rychleji, než si lidé myslí.

Milan Matějíček

zdroj: OpenAI

Já si myslím, že pokud umělá inteligence a jeji vylepšení budou hodně rozšiřená v humanojidních robotech, nic jim nezabrání si podmanít lidstvo a ovládnout s moci, kterou budou mít!

Nabízí se otázka: co bude s lidmi, kterých je většiná, a zastupuji dělnické profese? Kam půjdou, kde budou pracovat a na co žít?

Takže logicky řečeno, budou brané jako “nepotřebné” které jsou na obtíž a musí se odstranit, alespoň ve větší části!

Nejsem nějak chytrá ale “vidím” to tak a mrazí mně z toho…

Je vůbec pojem “lidskost” ještě populární?